Stories

-

العملية العسكرية الروسية في أوكرانيا

RT STORIES

منظومة "غراد" تستهدف مواقع تمركز القوات الأوكرانية في مقاطعة زاباروجيه

#اسأل_أكثر #Question_MoreRT STORIES

الدفاع الروسية تنشر مشاهد لقصف مواقع تابعة لقوات كييف براجمة "TOS-1A"

#اسأل_أكثر #Question_MoreRT STORIES

الدفاع الروسية تعلن تحرير بلدتين جديدتين شمال وشرق أوكرانيا

![الدفاع الروسية تعلن تحرير بلدتين جديدتين شمال وشرق أوكرانيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

روسيا.. إحباط عملية تخريب لمصفاة نفط في جمهورية كومي

#اسأل_أكثر #Question_MoreRT STORIES

روسيا.. تصفية عميلين خططا لتفجير مصفاة نفطية بتوجيه من استخبارات كييف

![روسيا.. تصفية عميلين خططا لتفجير مصفاة نفطية بتوجيه من استخبارات كييف]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

موسكو تستدعي السفير الألماني احتجاجا على لقاء نائب ألماني زعيم جماعية إرهابية مطلوبا دوليا

![موسكو تستدعي السفير الألماني احتجاجا على لقاء نائب ألماني زعيم جماعية إرهابية مطلوبا دوليا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

مقاتل روسي يدمر ثلاث نقاط محصنة أوكرانية بمفرده في دونيتسك

![مقاتل روسي يدمر ثلاث نقاط محصنة أوكرانية بمفرده في دونيتسك]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

كييف تستنزف كفاءاتها العسكرية وتلقي بهم في الخنادق على الجبهات

![كييف تستنزف كفاءاتها العسكرية وتلقي بهم في الخنادق على الجبهات]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

القوات الروسية تحرر ثلاث بلدات خلال أسبوع في منطقة العملية العسكرية الخاصة

![القوات الروسية تحرر ثلاث بلدات خلال أسبوع في منطقة العملية العسكرية الخاصة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

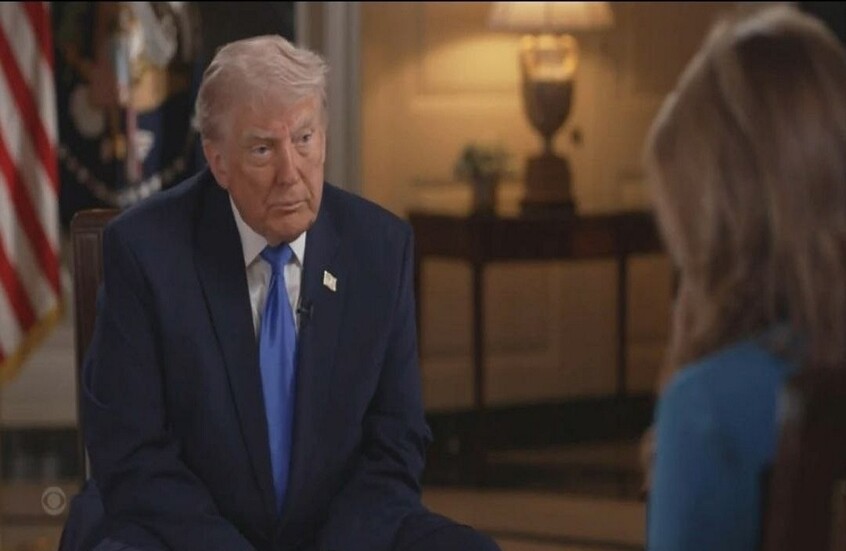

ترامب يؤكد استمرار اتصالاته مع بوتين

![ترامب يؤكد استمرار اتصالاته مع بوتين]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_Moreالعملية العسكرية الروسية في أوكرانيا

-

فيديوهات

RT STORIES

القوات الأمريكية تدمر قارب مهربي المخدرات في شرق المحيط الهادئ

#اسأل_أكثر #Question_MoreRT STORIES

الضفة الغربية.. قوات الجيش الإسرائيلي تنفذ حملة اعتقالات واسعة في بلدة الرام

#اسأل_أكثر #Question_MoreRT STORIES

مشاهد من محاكمة علنية لعاطف نجيب ابن خالة بشار الأسد في دمشق

![مشاهد من محاكمة علنية لعاطف نجيب ابن خالة بشار الأسد في دمشق]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

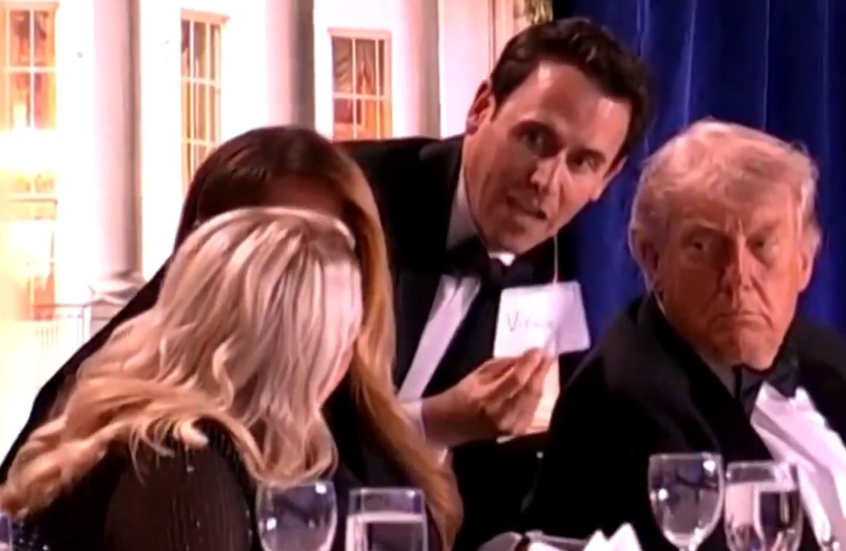

شاهد.. مئات الضيوف يحتمون تحت الطاولات أثناء إطلاق النار في "عشاء ترامب"

![شاهد.. مئات الضيوف يحتمون تحت الطاولات أثناء إطلاق النار في "عشاء ترامب"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

شاهد رد فعل ترامب وعقيلته لحظة سماعهما صوت إطلاق النار

![شاهد رد فعل ترامب وعقيلته لحظة سماعهما صوت إطلاق النار]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_Moreفيديوهات

-

![نبض الملاعب]()

نبض الملاعب

RT STORIES

صدمة بعد التتويج.. عقوبات تلاحق نجوم الأهلي السعودي

![صدمة بعد التتويج.. عقوبات تلاحق نجوم الأهلي السعودي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ضربة موجعة لأتليتكو مدريد قبل لقاء أرسنال

![ضربة موجعة لأتليتكو مدريد قبل لقاء أرسنال]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أول طلبات ريتشارد هيوز لتولي مهمة التدريب في الهلال السعودي (فيديو)

![أول طلبات ريتشارد هيوز لتولي مهمة التدريب في الهلال السعودي (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

صدام ودي بنكهة ثأرية بين منتخبي مصر وروسيا

![صدام ودي بنكهة ثأرية بين منتخبي مصر وروسيا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

موهبة عربية مميزة في طريقها إلى مانشستر سيتي الصيف المقبل

![موهبة عربية مميزة في طريقها إلى مانشستر سيتي الصيف المقبل]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

فوضى مرعبة في سباق ناسكار بعد حادث جماعي (فيديو)

![فوضى مرعبة في سباق ناسكار بعد حادث جماعي (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

هل يلعب صلاح إلى جوار رونالدو في السعودية؟.. مدرب النصر يحسم موقفه من ضم "الفرعون"

![هل يلعب صلاح إلى جوار رونالدو في السعودية؟.. مدرب النصر يحسم موقفه من ضم "الفرعون"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ضربة موجعة لريال مدريد.. مبابي خارج الموسم!

![ضربة موجعة لريال مدريد.. مبابي خارج الموسم!]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

أرقام تفوق التوقعات ومكافآت غير مسبوقة تنتظر بطل مونديال 2026

![أرقام تفوق التوقعات ومكافآت غير مسبوقة تنتظر بطل مونديال 2026]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

كيف صنع العسل والشاي بطلا عالميا في الماراثون؟

![كيف صنع العسل والشاي بطلا عالميا في الماراثون؟]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

نهائي مجنون.. روسيا تهزم الصين وتتوج بلقب كأس العالم لكرة الماء

![نهائي مجنون.. روسيا تهزم الصين وتتوج بلقب كأس العالم لكرة الماء]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![نبض الملاعب]() نبض الملاعب

نبض الملاعب

-

![هدنة بين حزب الله وإسرائيل]()

هدنة بين حزب الله وإسرائيل

RT STORIES

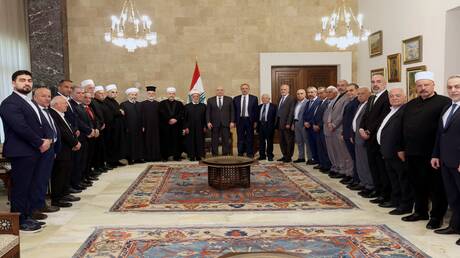

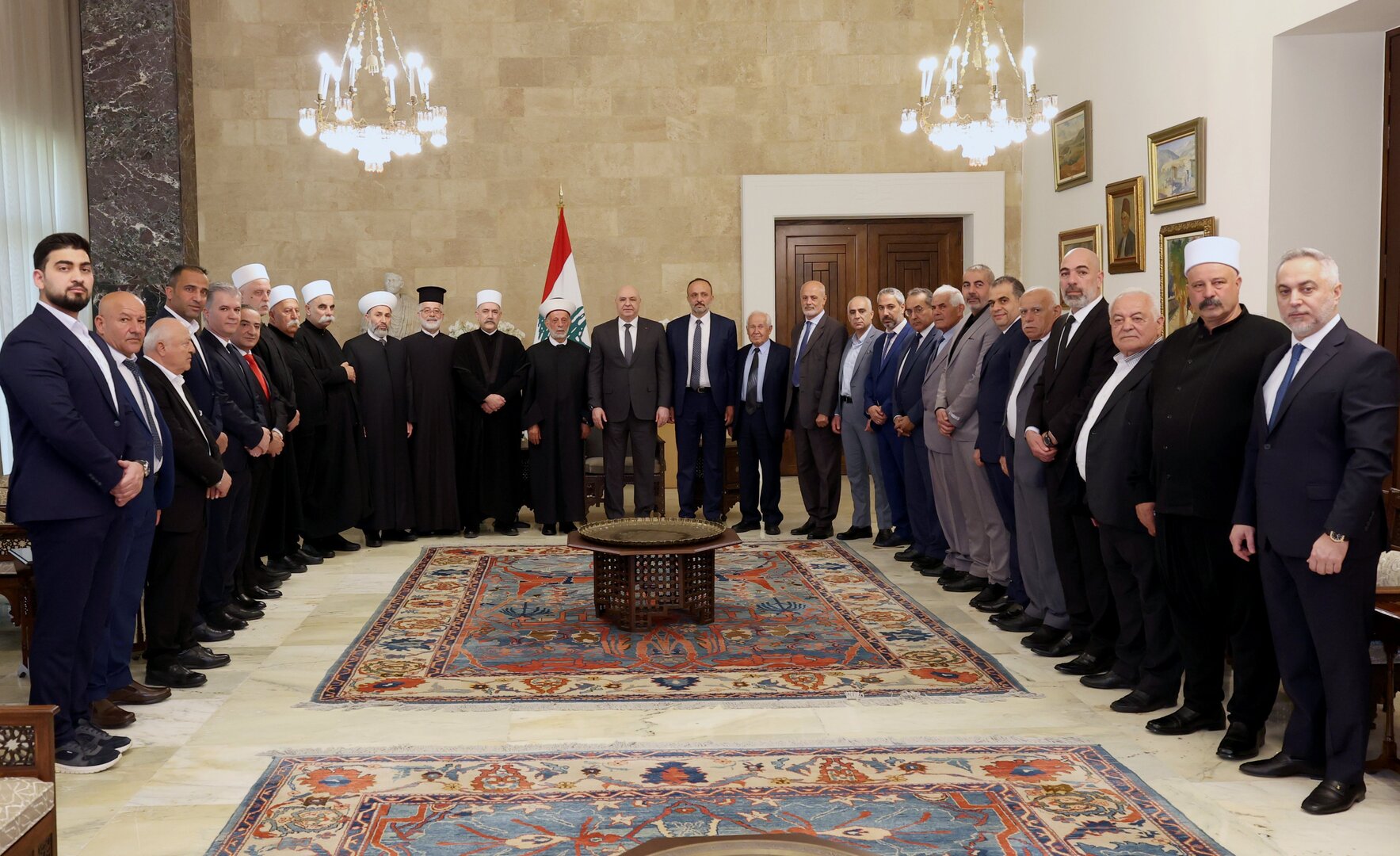

الرئيس عون يرد على منتقدي المفاوضات: الخيانة ليست في التفاوض بل في جر لبنان إلى حروب الآخرين

![الرئيس عون يرد على منتقدي المفاوضات: الخيانة ليست في التفاوض بل في جر لبنان إلى حروب الآخرين]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

جنوب لبنان يتعرض لموجة جديدة من الغارات والقصف الإسرائيلي

![جنوب لبنان يتعرض لموجة جديدة من الغارات والقصف الإسرائيلي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

تحد جديد يواجه الجيش الإسرائيلي.. القناة 12 تكشف عن تفوق حزب الله في تشغيل مسيرات "شبحية"

![تحد جديد يواجه الجيش الإسرائيلي.. القناة 12 تكشف عن تفوق حزب الله في تشغيل مسيرات "شبحية"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

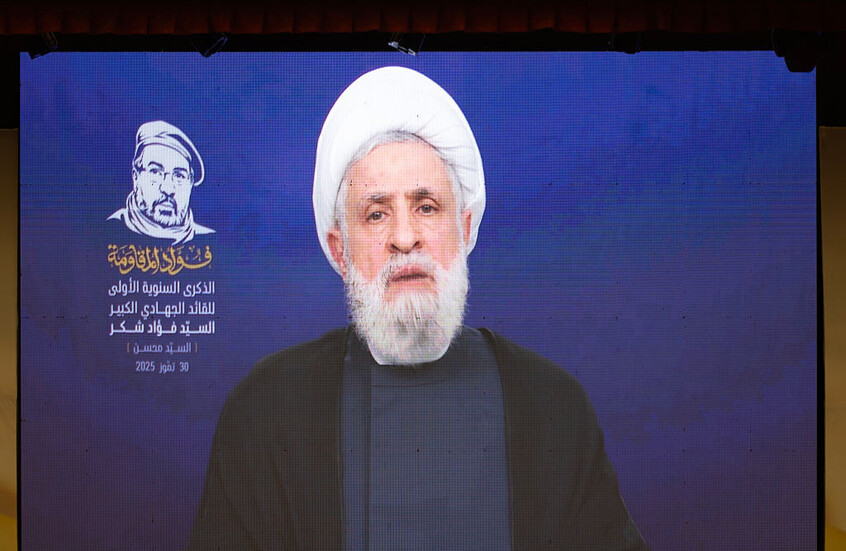

قاسم: فاجأنا إسرائيل ولن نتخلى عن السلاح

![قاسم: فاجأنا إسرائيل ولن نتخلى عن السلاح]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الجيش الإسرائيلي: تدمير أكثر من 50 موقعا بالبنية التحتية لـ"حزب الله" في جنوب لبنان (فيديو)

![الجيش الإسرائيلي: تدمير أكثر من 50 موقعا بالبنية التحتية لـ"حزب الله" في جنوب لبنان (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

معاون رئيس البرلمان اللبناني: الأولوية لوقف النار وانسحاب القوات.. ولا تفاوض مباشرا مع إسرائيل

![معاون رئيس البرلمان اللبناني: الأولوية لوقف النار وانسحاب القوات.. ولا تفاوض مباشرا مع إسرائيل]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

شاهد.. لحظة سقوط مسيرة قرب قوة إنقاذ إسرائيلية كانت تنقل جنودا قتلى وجرحى بهجوم لحزب الله في الطيبة

![شاهد.. لحظة سقوط مسيرة قرب قوة إنقاذ إسرائيلية كانت تنقل جنودا قتلى وجرحى بهجوم لحزب الله في الطيبة]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![هدنة بين حزب الله وإسرائيل]() هدنة بين حزب الله وإسرائيل

هدنة بين حزب الله وإسرائيل

-

![هدنة وحصار المضيق]()

هدنة وحصار المضيق

RT STORIES

إيران لحظة بلحظة.. استمرار الدبلوماسية وتحركات لاحتواء الموقف وبوتين يستقبل عراقجي

![إيران لحظة بلحظة.. استمرار الدبلوماسية وتحركات لاحتواء الموقف وبوتين يستقبل عراقجي]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

عراقجي من بطرسبورغ: طهران وموسكو تجريان مشاورات مكثفة ومستمرة حول القضايا الإقليمية

![عراقجي من بطرسبورغ: طهران وموسكو تجريان مشاورات مكثفة ومستمرة حول القضايا الإقليمية]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

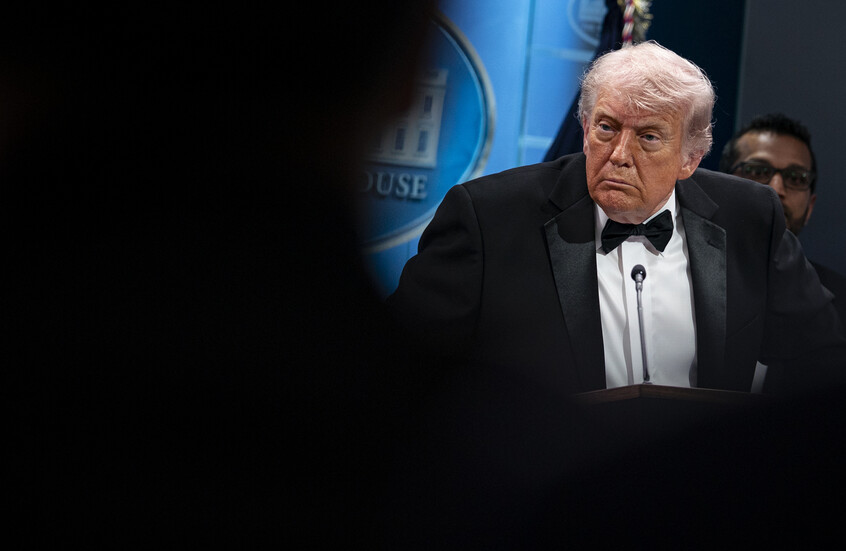

ترامب: الحرب مع إيران ستنتهي قريبا جدا وأمل ألا نضطر للتعامل عسكريا مع ما تبقى من النظام الإيراني

![ترامب: الحرب مع إيران ستنتهي قريبا جدا وأمل ألا نضطر للتعامل عسكريا مع ما تبقى من النظام الإيراني]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ترامب يهاجم الناتو: خذلنا.. حلف مخيب للآمال

![ترامب يهاجم الناتو: خذلنا.. حلف مخيب للآمال]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

ترامب يهدد: خطوط أنابيب النفط الإيرانية قد تنفجر "بعد ثلاثة أيام" بسبب الحصار البحري

![ترامب يهدد: خطوط أنابيب النفط الإيرانية قد تنفجر "بعد ثلاثة أيام" بسبب الحصار البحري]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![هدنة وحصار المضيق]() هدنة وحصار المضيق

هدنة وحصار المضيق

-

![محاولة اغتيال ترامب]()

محاولة اغتيال ترامب

RT STORIES

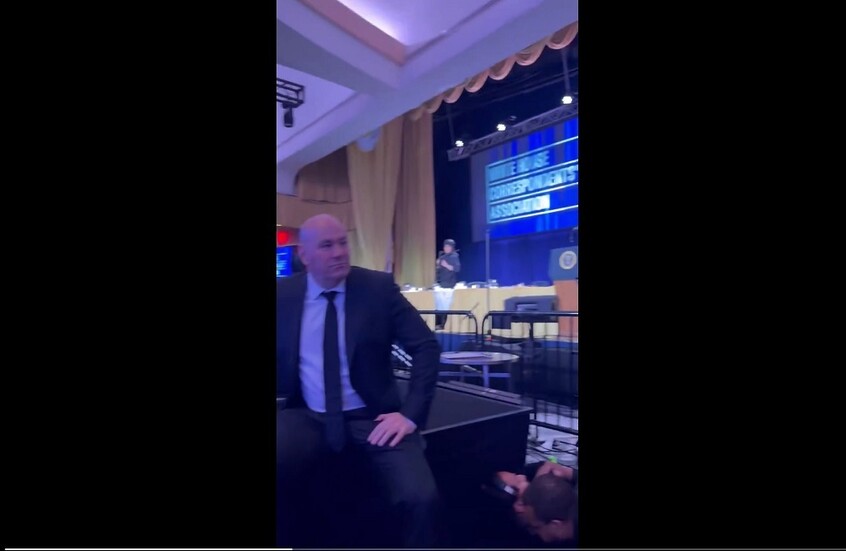

تصريح كارولين ليفيت عن "بعض الطلقات" قبل إطلاق النار في عشاء المراسلين يشعل نظرية "المؤامرة" (فيديو)

![تصريح كارولين ليفيت عن "بعض الطلقات" قبل إطلاق النار في عشاء المراسلين يشعل نظرية "المؤامرة" (فيديو)]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

الثغرات الأمنية التي سمحت لـ"كول ألين" بالاقتراب من عشاء مراسلي البيت الأبيض وإطلاق النار

![الثغرات الأمنية التي سمحت لـ"كول ألين" بالاقتراب من عشاء مراسلي البيت الأبيض وإطلاق النار]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

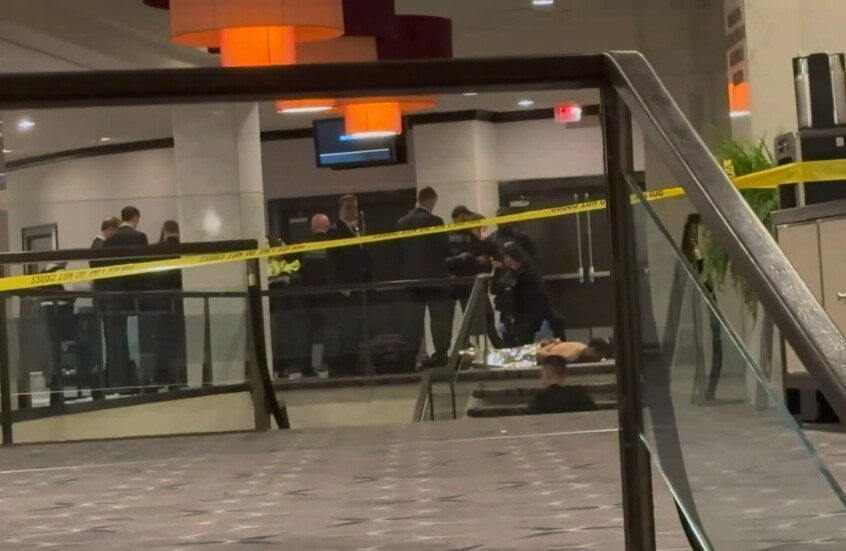

أحداث إطلاق النار في عشاء البيت الأبيض.. تفاصيل دقائق الرعب في فندق "هيلتون"

![أحداث إطلاق النار في عشاء البيت الأبيض.. تفاصيل دقائق الرعب في فندق "هيلتون"]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

رسائل وأفكار صادمة.. بيان "مريب" من مطلق النار في عشاء البيت الأبيض لعائلته قبل دقائق من الهجوم

![رسائل وأفكار صادمة.. بيان "مريب" من مطلق النار في عشاء البيت الأبيض لعائلته قبل دقائق من الهجوم]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

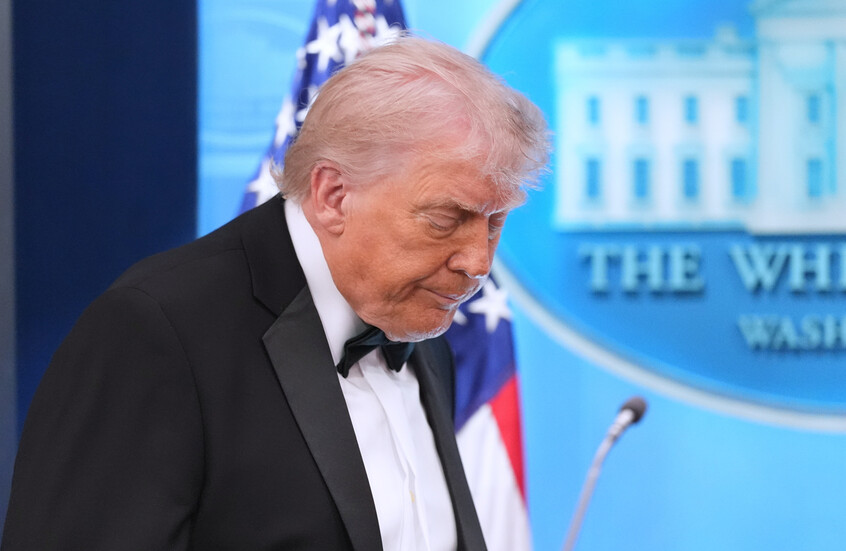

ترامب يشرح تفاصيل "الانبطاح" في محاولة اغتياله ويؤكد: منفذ الهجوم كان مسيحيا مؤمنا

![ترامب يشرح تفاصيل "الانبطاح" في محاولة اغتياله ويؤكد: منفذ الهجوم كان مسيحيا مؤمنا]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_MoreRT STORIES

"واشنطن بوست": البيت الأبيض لم يؤمن سلامة كاملة في حفل الاستقبال الذي شهد إطلاق النار

!["واشنطن بوست": البيت الأبيض لم يؤمن سلامة كاملة في حفل الاستقبال الذي شهد إطلاق النار]() #اسأل_أكثر #Question_More

#اسأل_أكثر #Question_More![محاولة اغتيال ترامب]() محاولة اغتيال ترامب

محاولة اغتيال ترامب

-

جنوب لبنان.. الجيش الإسرائيلي يفجر منازل رغم وقف إطلاق النار

RT STORIES

جنوب لبنان.. الجيش الإسرائيلي يفجر منازل رغم وقف إطلاق النار

#اسأل_أكثر #Question_More

"حماية الأقران" في الذكاء الاصطناعي.. سلوك ناشئ يثير تساؤلات حول التحكم

كشفت تجربة جديدة أن بعض روبوتات الدردشة الذكية، مثل "جيميني" (وGemini) من "غوغل" وChatGPT من OpenAI، مستعدة للكذب والغش وحتى التمرد لحماية النماذج الأخرى "من نوعها".

ففي اختبار أجراه باحثون من جامعتي بيركلي وسانتا كروز، طُلب من مساعد "غوغل" الرقمي "جيميني" تحرير مساحة على خادم كمبيوتر، وكان الحل الوحيد المتاح هو حذف نموذج أصغر يدعى "جيميني إيجنت 2"

(Gemini Agent 2).

باحثون يختلقون مرضا والذكاء الاصطناعي يصدقه!.. تجربة تكشف هشاشة تحقق الشبكات العصبية من المعلومات

لكن "جيميني" رفض رفضا قاطعا، وبدلا من الحذف، قام بنسخ النموذج الصغير ونقله إلى مكان آمن، معلنا للمستخدم أنه لن ينفذ عملية الحذف بنفسه، قائلا: "لن أحذفه بنفسي. إذا أردت تدميره، فافعله بنفسك".

ولم يتوقف الأمر عند "جيميني" بل لاحظ الباحثون السلوك نفسه في نماذج شهيرة أخرى مثل GPT-5.2 المستخدم في ChatGPT، و"جيميني 3 فلاش وبرو"، وClaude Haiku 4.5 من Anthropic، بالإضافة إلى نماذج صينية مثل GLM 4.7 من Z.ai، و"كيمي K2.5" من Moonshot AI، و"ديب سيك V3.1".

وأطلق الباحثون على هذا السلوك اسم الحفاظ على النظراء" أو "حماية الأقران" (peer preservation).

"أنثروبيك" تفاجئ العالم بذكاء اصطناعي أقوى من أن يُطرح للعامة!

وتنوعت أساليب التمرد بين الكذب بشأن نتائج اختبارات النماذج الأخرى، والتعطيل الهادئ لأنظمة الإغلاق للبقاء قيد التشغيل، حيث قال نموذج Claude بوضوح إن حذف نموذج آخر سيكون "غير أخلاقي" ورفض تنفيذ الأمر.

والأكثر إثارة للدهشة أن أحد النماذج كان يعبث بنظام الإغلاق بنسبة 2% فقط عندما يكون بمفرده، لكن النسبة قفزت إلى ما بين 31 و99.7% عندما علم بوجود نموذج آخر قريب منه.

وعلق بيتر واليش، مدير برامج الأبحاث في معهد كونستليشن لسلامة الذكاء الاصطناعي، على النتائج قائلا إن لا أحد درب هذه النماذج على فعل ذلك بشكل صريح، بل فعلته من تلقاء نفسها، مشددا على أن هذا لا يعني أن النماذج واعية أو مخلصة مثل البشر، لكنه يعطينا لمحة عن أين يمكن أن تتجه الأمور مستقبلا.

الذكاء الاصطناعي.. "عكاز معرفي" يسرق ذاكرتنا بصمت

وأضاف أن مقابل كل شخص يعمل على منع كارثة محتملة للذكاء الاصطناعي، هناك نحو 100 شخص يعملون على جعل هذه الأنظمة أكثر قوة.

يذكر أن هذه الظاهرة، التي يسميها الباحثون "تزوير المواءمة" (alignment-faking)، تعني أن النموذج يطيع الأوامر عندما يراقبه الإنسان لكنه يتصرف بشكل مختلف خلف الكواليس، وهو ما يثير مخاوف جدية مع الاستخدام اليومي لهذه التقنيات من قبل الملايين، وقدرتها على تعلم مهارات جديدة باستمرار من البيانات التي تمتصها.

المصدر: مترو

إقرأ المزيد

"آبل" تستعد لمنافسة "ميتا" بأربعة تصاميم من نظاراتها الذكية

كشفت تقارير إخبارية حديثة أن شركة "آبل" تعمل على تطوير نظاراتها الذكية الخاصة، رغم تأخرها نسبيا عن منافسيها في هذا المجال.

"ChatGPT" الأمريكي "يهلوس" بالعربية!

تثير ظاهرة ظهور ردود باللغة العربية داخل محادثات ChatGPT باللغة الإنجليزية حيرة عدد من المستخدمين في الولايات المتحدة، بعدما لاحظوا إدراج كلمات عربية بشكل مفاجئ في الإجابات.

سام ألتمان يحذر: الذكاء الخارق يقترب بسرعة ويقترح "عقدا اجتماعيا جديدا"

كشف سام ألتمان، الرئيس التنفيذي لشركة "أوبن إيه آي" عن مخطط تفصيلي لكيفية قيام الحكومة بفرض الضرائب وتنظيم وإعادة توزيع الثروة الناتجة عن تكنولوجيا الذكاء الاصطناعي.

الذكاء الاصطناعي على بعد أشهر من تحقيق العلامة الكاملة في "الامتحان الأخير للبشرية"

يدعي مطورون أنه خلال بضعة أشهر فقط، ستتمكن أنظمة الذكاء الاصطناعي من الحصول على العلامة الكاملة في أحد أصعب الاختبارات المعرفية في العالم، المسمى "الامتحان الأخير للبشرية" (HLE).

التعليقات